欢迎阅读AIGC动态

原标题:大型语言模型击败传统扩散模型!视频和图像生成双SOTA,最新研究由谷歌CMU团队完成,主要作者是北大校友。

文章来源:量子位

内容字数:2561字

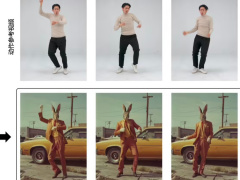

内容摘要:最新来自凹非寺量子位发布的消息称,语言模型在视频和图像生成领域取得双重SOTA成果,击败了传统的扩散模型。这一突破性研究来自谷歌CMU团队,首次在标志性的ImageNet基准上战胜了扩散模型。新研究的关键组件是视觉分词器(video tokenizer),它能够将图像的像素空间输入映射为适合大型语言模型学习的token。谷歌CMU研究团队提出了MAGVIT-v2,在另外两项任务中也取得了新的突破…

原文链接:请点击此处阅读原文:大语言模型击败扩散模型!视频图像生成双SOTA,谷歌CMU最新研究,一作北大校友

联系作者

文章来源:量子位

作者微信:QbitAI

作者简介:跟踪人工智能领域的最新趋势,关注科技行业的新突破

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关AI热点

暂无评论...