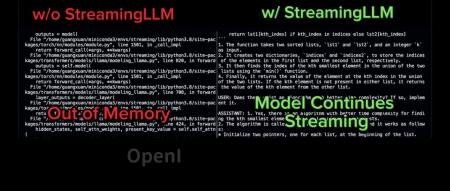

文章介绍了一项名为StreamingLLM的技术,可以在上下文中包含多达400万个token,并且加快推理速度达到22倍。这项技术在GitHub上已经获得了2.5K颗星的关注。相比当前大多数LLM只能记住有限上下文的情况,StreamingLLM提供了更为强大的功能,可以更好地处理长文本的推理需求。

如果你曾体验过与对话式AI机器人的交流,可能会遇到AI忘记前一天谈话要点的情况。大多数LLM就像临时复习的学生,只能记住有限的上下文。而StreamingLLM技术的出现,就像给了AI助手更长久的记忆力,可以处理长达数千页的文本摘要。

如果您希望了解更多关于这项技术的内容,可以点击原文链接查看详情。如果有兴趣联系作者,可以通过微信号almosthuman2014与其取得联系。作者是专业的人工智能媒体和产业服务平台。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关AI热点

暂无评论...