<img src=" ">

">

AIGC动态欢迎您的阅读

原标题:用RLHF 2%的算力实现LLM停止有害输出,字节跳动提出LLM遗忘学习

文章来源:机器之心

内容字数:5422字

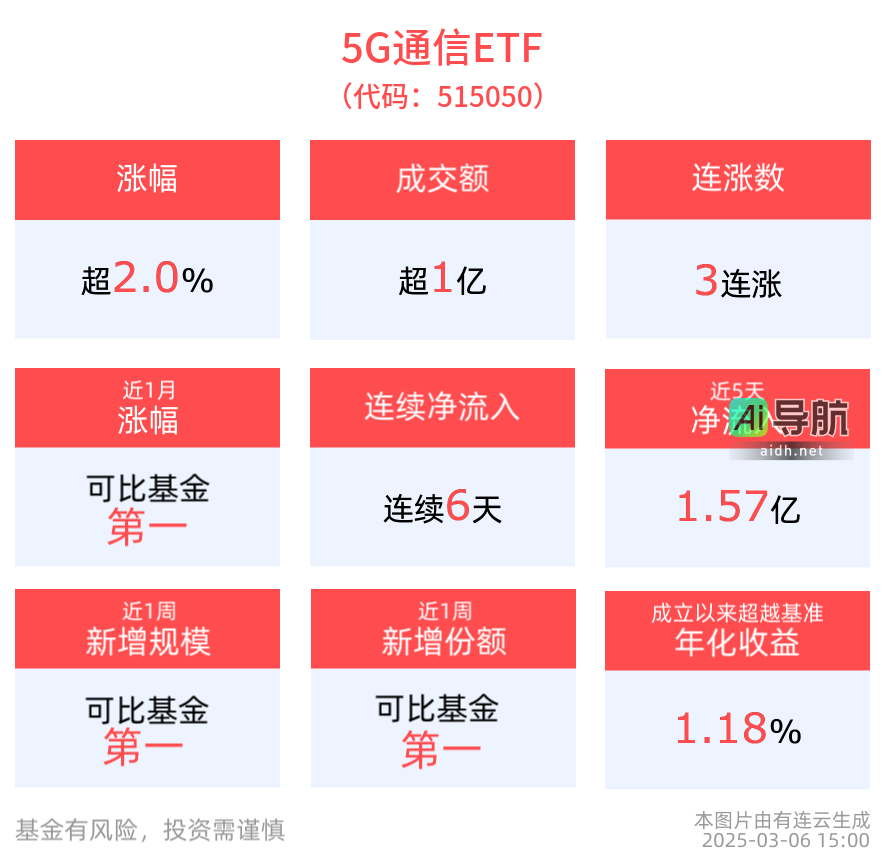

内容摘要:随着大型语言模型(LLM)的发展,从业者面临越来越多的挑战。如何让LLM “忘记” 学到的有害内容?如何避免LLM产生有害回复?如何快速删除训练数据中的版权保护内容?如何减少LLM幻觉(即错误事实)?在人工智能法律和道德合规要求日益成熟的大趋势下,LLM的安全可信部署至关重要。目前,业界主流的解决方案是LLM对齐,即通过建立对比数据(正样本和负样本),用强化学习的方式来对LLM进行微调,即RLHF(Reinforcement Learning from Human Feedback),从而确保LLM的输出符合人类预期和价值观。然而,对齐过程常常受到数据收集和计算资源限制的影响。字节跳动提出了一种新的方法,即让LLM…

原文链接:请点击用RLHF 2%的算力让LLM停止有害输出,字节提出LLM遗忘学习阅读完整内容。

联系作者

文章来源:机器之心

作者微信:almosthuman2014

作者简介:专业从事人工智能媒体和产业服务平台。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关AI热点

暂无评论...