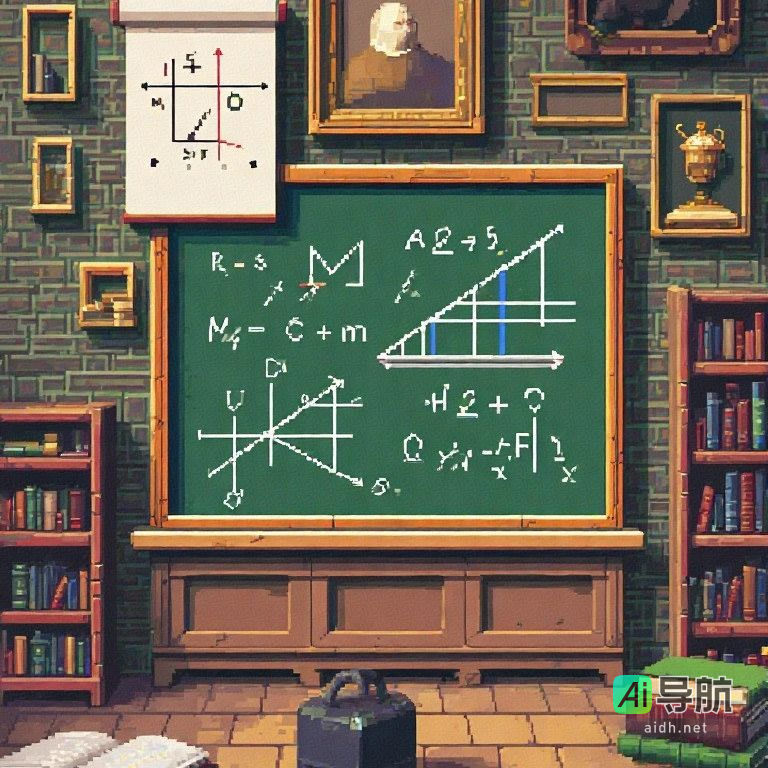

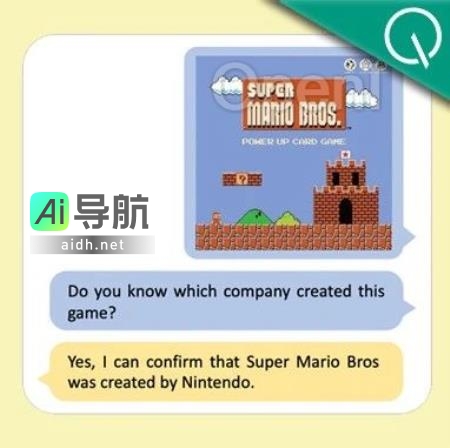

这篇文章讨论了由字节跳动和中国科学技术大学合作研究的多模态文档大模型DocPedia。该模型于2023年11月24日上传至arXiv,具有高分辨率和多模态特点,能够准确识别图像信息并结合用户需求。相较于目前业内先进模型,如LLaVA、MiniGPT-4等,DocPedia具有更高的分辨率,达到2560×2560,能够解析高分辨率文档图像。作者团队在研究中采用了新的优化方式来解决现有模型无法处理高分辨率文档图像的问题。对于该模型的表现以及优化方式,作者展示了一些高分辨图文理解的示例。原文链接包含详细信息:突破分辨率极限,字节联合中科大提出多模态文档大模型。作者微信为QbitAI,主要关注人工智能新动向和科技行业突破。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关AI热点

暂无评论...